RAG vs fine-tuning: kako firme zaista povezuju AI sa svojim podacima (bez halucinacija)

Kad neko kaže “hoćemo AI koji zna našu dokumentaciju”, mnogi prvo pomisle da treba “istrenirati model na našim PDF-ovima”. U praksi, najčešće rešenje je drugačije: RAG (Retrieval-Augmented Generation) — model koji pretražuje tvoje podatke i koristi ih kao kontekst dok odgovara.

Fine-tuning i RAG su oba validni, ali služe različitim ciljevima. Ako izabereš pogrešno, dobiješ ili skupo rešenje, ili AI koji deluje pametno, a priča napamet.

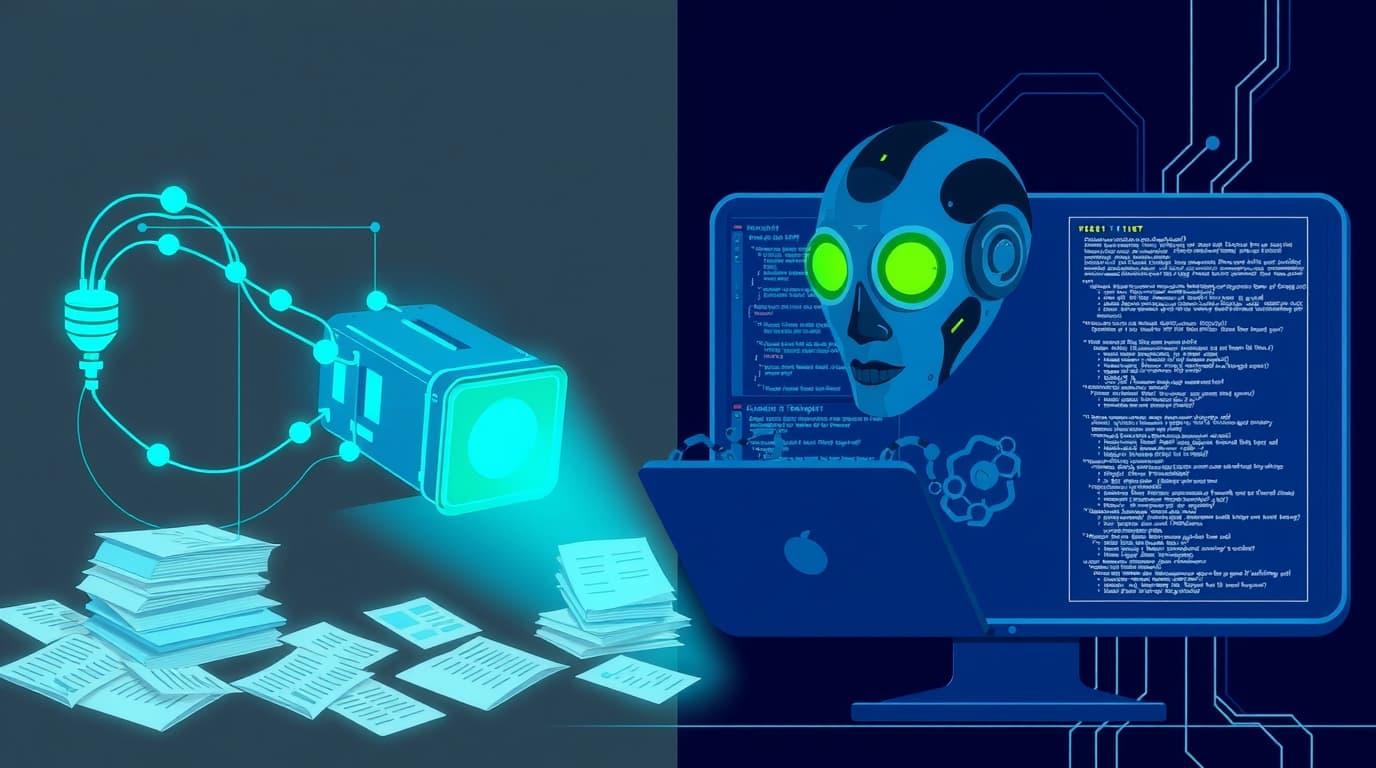

Šta je RAG (najjednostavnije)

RAG znači da model pre odgovora:

- pretvori pitanje u “pretragu”,

- pronađe relevantne odlomke iz tvoje baze (dokumenti, FAQ, ugovori, wiki),

- ubaci te odlomke u prompt kao kontekst,

- tek onda generiše odgovor.

Poenta: model ne mora da “pamti” sve, već čita iz izvora kad treba.

Zašto RAG radi dobro

- Brzo se uvodi (dani/nedelje, ne meseci)

- Lako se ažurira (promeniš dokument → odmah važi)

- Manje halucinacija (jer ima citiran kontekst)

- Manje regulatornog stresa (podaci mogu ostati u kontroli, uz pravila pristupa)

Šta je fine-tuning (i čemu stvarno služi)

Fine-tuning je dodatno treniranje modela na tvom setu primera, da bi:

- bolje pratio željeni stil (ton, format, strukturu),

- bolje radio specifične klasifikacije,

- doslednije odgovarao u ponavljajućim šablonima.

Važno: fine-tuning nije idealan način da “ubaciš celu dokumentaciju u model”. Model i dalje može da pogreši, a održavanje je teže.

Kada fine-tuning ima smisla

- Kad ti treba specifičan format izlaza (npr. JSON šeme, forme, standardizovani izveštaji)

- Kad imaš puno “pravila pisanja” (brand voice, terminologija, struktura odgovora)

- Kad radiš klasifikaciju/označavanje (tagovanje ticket-a, routing, intent)

RAG vs fine-tuning: brza tabela u glavi

Ako ti se podaci često menjaju → RAG

Ako ti treba ponašanje/stil/format → fine-tuning

Ako ti treba i jedno i drugo → kombinacija

Najčešći “real life” scenario: RAG + malo fine-tuning-a

U praksi, mnogi završe sa hibridom:

- RAG daje tačne informacije iz dokumenata

- Fine-tuning “uči” model kako da piše odgovore (kratko, formalno, sa koracima, bez improvizacije)

To je često najbolji balans: istina dolazi iz dokumenata, a forma iz treninga.

7 brzih provera pre nego što uložiš vreme i novac

-

Da li ti je problem znanje ili format?

Ako je znanje → RAG. Ako je format → fine-tuning. -

Koliko se često menjaju dokumenti?

Ako se menjaju često → RAG je prirodniji. -

Da li mora da navodi izvore?

Ako da → RAG (lakše ubaciš citate/odlomke). -

Koliko je osetljivo?

Ako je jako osetljivo → planiraj kontrole pristupa, logove, i minimizaciju podataka. -

Koji je “failure mode” najgori?

Ako je najgore da “izmisli” → forsiraj retrieval i stroža pravila odgovaranja. -

Da li ti treba više jezika?

RAG često lakše skaluje jer sadržaj može biti višejezičan, a model samo “čita”. -

Koliko ti je bitna cena po upitu?

RAG može biti skuplji po upitu (retrieval + duži prompt), fine-tuning skuplji unapred (trening), pa biraš šta ti više odgovara.

Zaključak

Ako praviš “AI koji zna našu bazu znanja”, RAG je najčešće prvi i najbolji korak: brže, fleksibilnije i lakše za održavanje. Fine-tuning je odličan kad želiš da AI bude dosledan u ponašanju, tonu i formatu — ali nije magičan način da model “proguta” svu dokumentaciju.

Disclaimer: Tekst ima informativni karakter i ne predstavlja profesionalni savet za implementaciju, bezbednost ili usklađenost sistema.